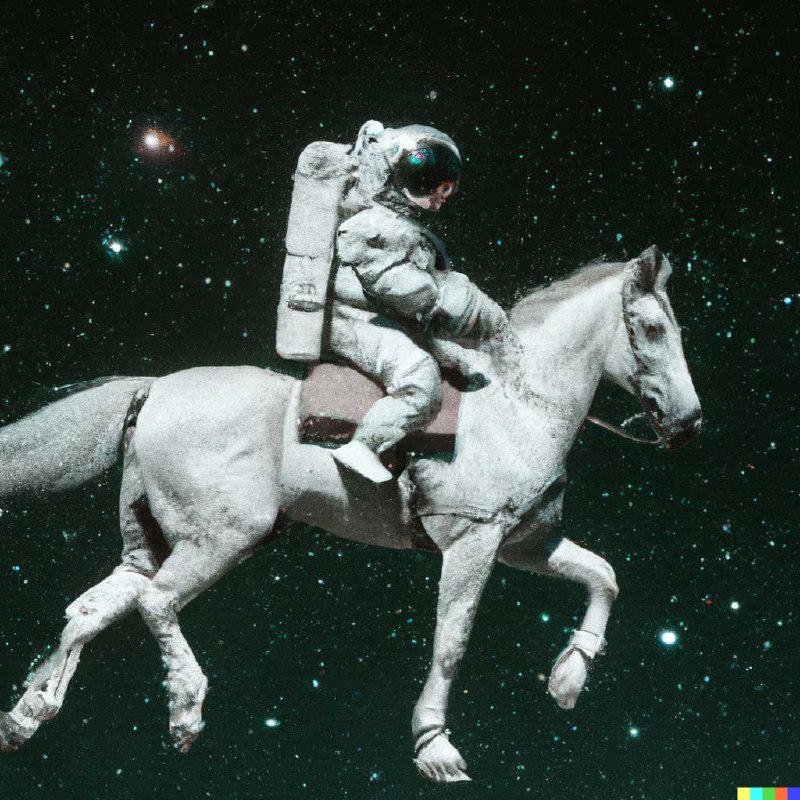

DALL-E 已能够通过文字描述生成逼真图像,专业人士担忧会让虚假信息更容易传播

当有人描述DALL-E的图像时,它就会产生一组该图像可能包括的关键特征。一个特征可能是小号边缘的线条。另一个可能是泰迪熊耳朵顶部的曲线。

然后,第二个神经网络,称为扩散模型,创建图像并生成实现这些特征所需的像素。上周公布的最新版DALL-E与一篇描述该系统的新研究论文一起,生成了高分辨率的图像,在许多情况下看起来像照片。

专家认为,研究人员将继续磨练此类系统。最终,这些系统可以帮助公司改进搜索引擎、数字助理和其他通用技术,并为图形艺术家、程序员和其他专业人士实现新任务的自动化。

但这种潜力也有注意事项。人工智能系统可以显示出对妇女和有色人种的偏见,部分原因是它们从巨大的在线文本、图像和其他显示偏见的数据库中学习技能。它们可以被用来生成色情制品、仇恨言论和其他攻击性材料。许多专家认为,这项技术最终将使制造虚假信息变得如此容易,人们将不得不对他们在网上看到的几乎所有东西持怀疑态度。

“我们可以伪造文本。我们可以把文字变成某人的声音。我们可以伪造图像和视频,”埃齐奥尼博士说。”网上已经有虚假信息,但令人担心的是,这种虚假信息的规模会达到新的水平。”

OpenAI对DALL-E进行了严格的管理。它不会让外人自行使用该系统。它在其生成的每张图片的角落里都有一个水印。而且,尽管该实验室计划在本周向测试者开放该系统,但这个群体将是很小的。

—— 华盛顿邮报(节选)

发表回复