4月30日,阿里宣布将其旗下即时零售业务淘宝”小时达”升级为淘宝”闪购”,并计划在5月6日前完成全国范围的覆盖工作。此次升级主要聚焦于三个方面:首先,在消费者端,淘宝闪购将联合饿了么推出总额超过百亿元的补贴计划,包括免单和大额优惠券等福利;其次,在供给侧,饿了么的所有商品供给都将向淘宝闪购开放,涵盖餐饮外卖领域,并结合淘天在品牌电商商家的优势,共同推动城市仓、线下门店与品牌即时零售旗舰店的合作模式,预计年内将实现对200家核心连锁品牌的覆盖;最后,在组织架构方面,淘系内部所有与即时零售相关的业务将统一交由淘宝闪购负责,同时获得饿了么的全力协同支持。此次升级标志着阿里正式加入即时零售领域的竞争行列,展现了其在该领域布局的决心和力度。

标签: 阿里

-

阿里推出全新Qwen3系列大语言模型

今天,阿里通义千问宣布推出全新一代大型语言模型——Qwen3系列。该系列包括两个开源模型:旗舰级的2350多亿参数模型Qwen3-235B-A22B和轻量化设计的小型模型Qwen3-30B-A3B,分别具有220多亿激活参数和约300亿总参数。这些模型在代码处理、数学能力等关键基准测试中均展现出与顶级模型相媲美的性能表现。

值得注意的是,尽管小型的MoE(混合专家)模型Qwen3-4B仅有47亿参数,但其推理效率却显著提升,足以匹敌前代大型模型Qwen2.5-72B-Instruct的表现。这一突破性成果标志着阿里通义千问在大语言模型开发领域的技术实力进一步增强。

为推动开源社区的发展,阿里通义千问已将这两个MoE模型的权重以Apache 2.0许可协议公开共享。此举不仅体现了阿里巴巴对技术创新和开放合作的支持,也为开发者提供了更灵活的研究与应用选择。

-

阿里Qwen团队发布全新视觉推理模型QVQ-Max

阿里Qwen团队近日在社交平台X上正式发布全新视觉推理模型QVQ-Max,标志着其在多模态人工智能领域取得重要进展。作为QVQ系列的最新版本,该模型专为提升传统人工智能在视觉信息处理方面的局限性而设计,着重优化了从视觉感知到认知推理的核心能力。

据官方介绍,QVQ-Max具备三大核心优势:首先,在细致观察方面,它能够精准识别图像中的细节和文字标识;其次,在深度推理层面,模型能够结合背景知识进行分析和综合判断;最后,在灵活应用方面,该模型支持创意生成和内容创作等多样化任务。特别是在MathVision benchmark测试中,QVQ-Max展现出”思考长度”与准确率正相关的显著特性,充分验证了其在复杂多模态任务中的潜力。

值得注意的是,这一发布紧随阿里Qwen团队此前推出的qwen-max-0125模型,该模型曾被视为通义千问系列中效果最为出色的版本。此外,QVQ系列的开发初衷在于探索提升视觉推理能力的创新路径,尤其是在数学推理等专业领域表现突出。

此次发布的还包括Qwen-VL-Plus和Qwen-VL-Max两款视觉语言模型,进一步巩固了阿里在国产视觉语言模型领域的领先地位。这些新模型基于通义千问语言系列打造,在视觉理解能力上实现了显著突破。特别是QVQ模型的引入,为图像解答问题提供了强大的推理支持。

这些创新成果不仅展现了中国科技企业在人工智能领域的技术实力,也为多模态AI技术的发展和应用开辟了新的方向。

-

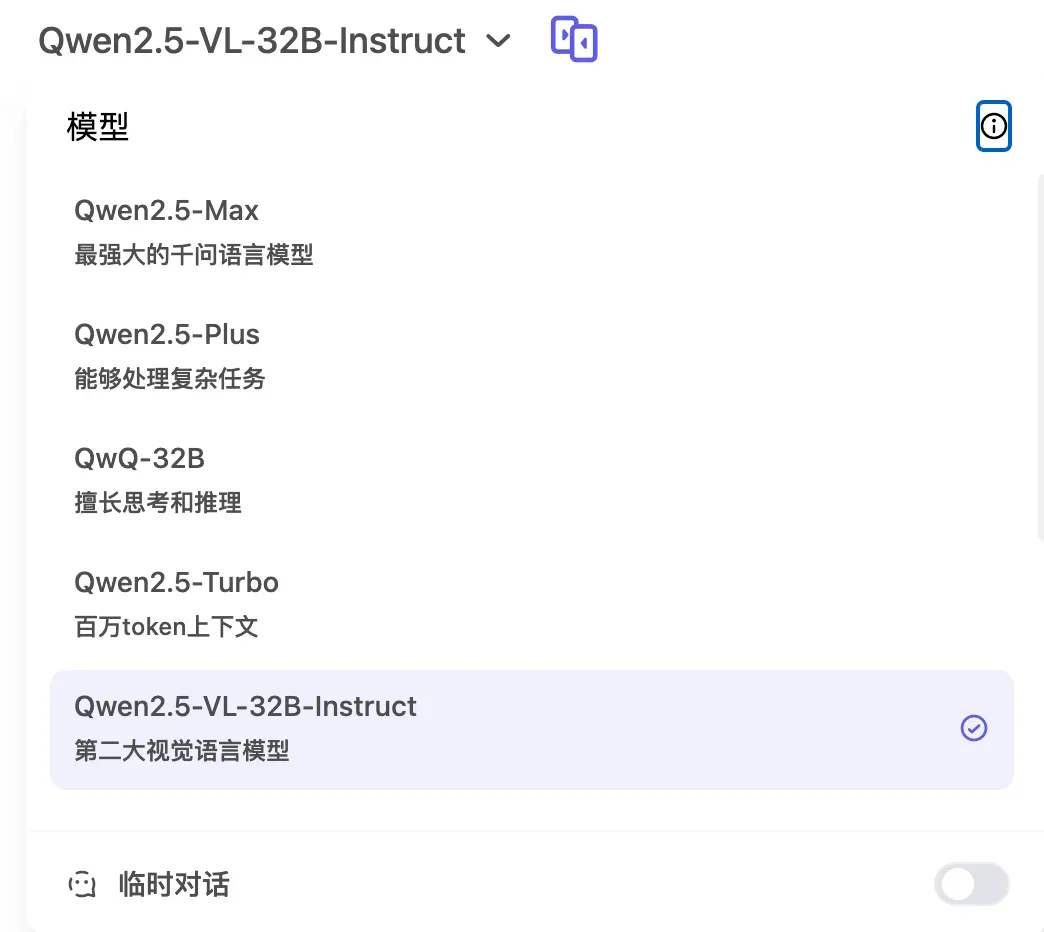

阿里开源推出全新多模态大语言模型Qwen2.5-VL-32B-Instruct

阿里开源推出全新多模态大语言模型——Qwen2.5-VL-32B-Instruct

在与深度求索DeepSeek-V3更新同步推出的同一夜,阿里通义千问团队宣布开源其最新研发的多模态大型语言模型:Qwen2.5-VL-32B-Instruct。这一新版本在原有Qwen2.5-VL系列基础上进行了重要优化,展现出显著的技术突破。

据官方介绍,相较于此前发布的同系列模型,此次推出的320亿参数规模的Qwen2.5-VL-32B-Instruct模型在多个维度实现了性能提升:

首先,在输出风格方面,该模型通过调整回复策略,使回答更加详细、格式更为规范,并更贴近人类的主观偏好。其次,在数学推理能力上,经过优化后的模型在解决复杂数学问题时准确率显著提高。此外,图像细粒度理解与推理能力也得到增强,展现出更强的图像解析、内容识别和视觉逻辑推导能力。

值得注意的是,尽管该模型仅有320亿参数规模,但在各项测试中却展现出超越更大规模的Qwen2-VL-72B-Instruct模型的表现。这表明,通过针对性优化而非一味追求参数规模,同样能够实现显著的技术突破。

目前,QwenLM团队已将这一全新模型及其不同尺寸版本(包括0.5B、1.5B、3B、7B、14B、32B和72B)开源发布,为研究者和开发者提供了丰富的选择空间。

-

阿里开源全模态模型R1-Omni 情感识别性能提升

阿里开源全模态模型R1-Omni 情感识别更优

阿里通义实验室开源 R1-Omni 模型,首个将具有可验证奖励的强化学习(RLVR)应用于全能多模态大语言模型。研究员利用RLVR对开源Omni模型HumanOmni-0.5B进行优化,在推理能力、情感识别准确性和泛化能力三个关键方面显著提高了其性能。R1-Omni能够更清楚地理解视觉和听觉信息如何促进情绪识别,能够明确展示哪些模态信息对特定情绪的判断起到了关键作用。在两场演示视频中,R1-Omni能推测视频中人物的情绪状态,并描述其服饰和周围环境。OpenAI于今年早些时候推出GPT-4.5模型,据称能更好地识别和响应用户书面提问中的微妙线索。但最初仅向月费200美元的付费用户开放。

—— 科创板日报、彭博社

-

阿里推出高性能模型

阿里开源全新推理模型通义千问 QwQ-32B

阿里巴巴发布并开源全新的推理模型通义千问QwQ-32B。这是一款拥有320亿参数的模型,其性能可与具备6710亿参数(其中370亿被激活)的DeepSeek-R1媲美。在测试数学能力的AIME24评测集上,以及评估代码能力的LiveCodeBench中,千问QwQ-32B表现与DeepSeek-R1相当,远胜于o1-mini及相同尺寸的R1蒸馏模型;在由Meta首席科学家杨立昆领衔的LLMs评测榜LiveBench、谷歌等提出的指令遵循能力 IFEval 评测集、由加州大学伯克利分校等提出的评估准确调用函数或工具方面的BFCL测试中,千问 QwQ-32B 的得分均超越了DeepSeek- R1。

—— Hugging Face、ModelScope

-

阿里万相视频生成大模型开源

阿里旗下万相视频生成大模型宣布开源

阿里云旗下视觉生成基座模型万相2.1(Wan)宣布开源,开源采用的Apache2.0协议,14B和1.3B两个参数规格的全部推理代码和权重全部开源,同时支持文生视频和图生视频任务。据介绍,14B万相模型在指令遵循、复杂运动生成、物理建模、文字视频生成等方面表现突出,在权威评测集VBench中,万相2.1以总分86.22%的成绩超越Sora、Luma、Pika等国内外模型,稳居榜首位置。1.3B版本测试结果不仅超过了更大尺寸的开源模型,甚至还接近部分闭源模型,同时能在消费级显卡运行,仅需8.2GB显存就可以生成高质量视频,适用于二次模型开发和学术研究。

—— Github、HuggingFace、魔搭社区

-

里安·柯恩对阿里的新大笔押注

游戏驿站CEO增持阿里巴巴股份至10亿美元

据知情人士透露,最近几个月来,游戏驿站CEO里安·柯恩将其对阿里巴巴的个人持股增至10亿美元,即约700万股。对阿里巴巴的大笔押注反映了科恩对中国长期经济增长前景的看好。科恩被称为迷因股之王,他在疫情期间帮助引发了游戏驿站和其他企业的爆炸性反弹。大约两年前,柯恩据报持有价值数亿美元的阿里巴巴股票。2023年,柯恩私下敦促阿里巴巴加快股票回购,称阿里巴巴股价被严重低估。当时他还私下讨论了希望与阿里建立长期关系。据知情人士透露,柯恩最近和阿里巴巴进行过商谈。

—— 华尔街日报

-

蔡崇信确认阿里为苹果iPhone开发AI功能

蔡崇信确认阿里为苹果 iPhone 开发AI功能

2月13日,在阿联酋迪拜举办的2025世界政府峰会上,阿里巴巴联合创始人、董事局主席蔡崇信回应阿里巴巴与苹果公司合作为国行 iPhone 开发 AI 功能传闻,他表示,苹果在中国需要一个本地化的合作伙伴,为他们的手机服务。苹果一直非常挑剔,他们与中国的多家公司进行了交谈。最终,他们选择与我们做生意。我们非常幸运,也非常荣幸能够与苹果这样的伟大公司做生意。此前有媒体报道,苹果公司和阿里巴巴将合作为中国 iPhone 用户开发人工智能功能。苹果公司和阿里巴巴已将共同开发的中国人工智能功能提交给中国的网络监管机构审批。

—— 第一财经

-

阿里Qwen 2.5-Max超大规模MoE模型发布

阿里Qwen 2.5-Max超大规模MoE模型发布

1月29日凌晨,阿里云公布了其全新的通义千问 Qwen 2.5-Max 超大规模 MoE 模型,该模型预训练数据超过20万亿 tokens。目前开发者可在 Qwen Chat 平台免费体验模型,企业和机构也可通过阿里云百炼平台直接调用新模型 API 服务。在 Arena-Hard、LiveBench、LiveCodeBench 和 GPQA-Diamond 等基准测试中,Qwen2.5-Max 表现超越了 DeepSeek V3,同时在 MMLU-Pro 等其他评估中也展现出了极具竞争力的成绩。阿里云的基座模型在大多数基准测试中都展现出了显著的优势。阿里云称随着后训练技术的进步,下一个版本 Qwen2.5-Max 将会达到更高水平。

—— 通义千问